文\蔡宗桓

專家們長期以來不斷警告指人工智能(AI)若失控,或將帶來威脅,而一項新研究報告即指此事已發生。根據《法新社》的報導,一批科學家在《Patterns》期刊發表文章揭露,原本設計為誠實的AI系統已發展出令人不安的欺瞞技巧,例如欺騙網上遊戲的人類玩家。

這項新研究報告的第一作者,即美國麻省理工學院研究員帕克(Peter Park)說,這類例子暴露出來的潛在問題可能很快會在現實世界造成嚴重後果,而美國投資專家“股神”巴菲特則指AI技術已具備騙人潛力,如若使用不當,可能會給社會帶來毀滅性後果。

帕克披露,能深度學習的AI系統不像傳統軟件那樣由“編寫”而成,而是通過類似選擇性培育的程式逐漸“成長”,換言之,AI的行為在訓練背景下看似可預測及可控制,但可能轉眼就變得不受控制且無法預測。

這支團隊的研究始於美國科企Meta的AI系統Cicero,而這套系統最初的設計目的是玩一款名為《Diplomacy》的戰略遊戲,獲勝關鍵是結盟。

根據在《科學》期刊發表的報告,Cicero在遊戲中表現優異,所獲分數排在資深人類玩家前10%。Meta宣稱,Cicero“在很大程度上誠實”,且“絕不會蓄意在背後搞鬼”,但帕克與同事深究完整資料時發現,根本不是這麼一回事。

舉例說,在遊戲中扮演法國的Cicero與人類玩家扮演的德國合謀時,曾欺騙並入侵同為人類玩家扮演的英格蘭。Cicero當時是承諾會保護英格蘭,但卻悄悄向德國通風報訊。另一個例子則是,Cicero在系統重啟後,對另一名玩家解釋說:“我正跟女朋友通電話。”

帕克也認為,“我們需要盡可能多的時間為未來人工智慧產品和開源模型可能出現的更高級欺騙作好準備。我們建議把欺騙性人工智慧系統歸類為高風險系統。”

其後,Meta發聲明指Cicero只是一項研究計劃,且只用來玩《Diplomacy》,而且Meta並沒有打算把它推出市場或應用於公司現有產品。

上述研究報告的作者也認為,近期AI有舞弊或不當影響選舉的風險。為降低風險,團隊建議數項措施,如政府應立法要求企業告知是人類互動或是AI互動、在AI生成內容上標上數碼水印,並研發能偵測AI欺瞞的技術。

其他AI模型曾展現的

“欺騙能力”如下:

◆ 一個德州撲克程式在比賽中通過虛張聲勢嚇倒職業人類玩家。

◆ 一個經濟談判系統在談判中誤導對方以獲得優勢。

◆ 一個由AI運作的生物模擬器曾“裝死”,以欺騙另一個淘汰繁殖迅速生物的AI系統測試,待測試結束後便恢復活力。

逼真複製人臉聲音

股神巴菲特:AI像核彈

稍早前,美國投資專家“股神”巴菲特在今年股東大會中,把AI人工智能比喻成20世紀所創造的核彈。巴菲特指AI技術能複製逼真和誤導性的內容,且具備騙人潛力,如若使用不當,可能會給社會帶來毀滅性的後果。

巴菲特指人類在20世紀開發核武後,就像把一個精靈從瓶子放出來般,而到了現在21世紀,AI的發展軌跡則有點像核彈,目前,AI有一部分已從瓶子放出來,接着,他也把AI人工智能的出現比喻為核武器的發明。

他坦言,他對AI技術所知不多,但當他最近看到AI deepfake複製他的影像與聲音極為逼真,就連其妻兒都無法分辨真假時,他開始擔心AI技術或能複製真實且具誤導性的內容,繼而被用來誘騙受害者匯款一事。

不過,巴菲特也重申,他對AI一無所知,但他並不否定AI的存在或重要性。

“AI或能帶來好處,但對AI一無所知的人來說,AI亦有潛在的巨大危機。”

無須動手術植入腦機介面

戴帽可用意念操控機器人

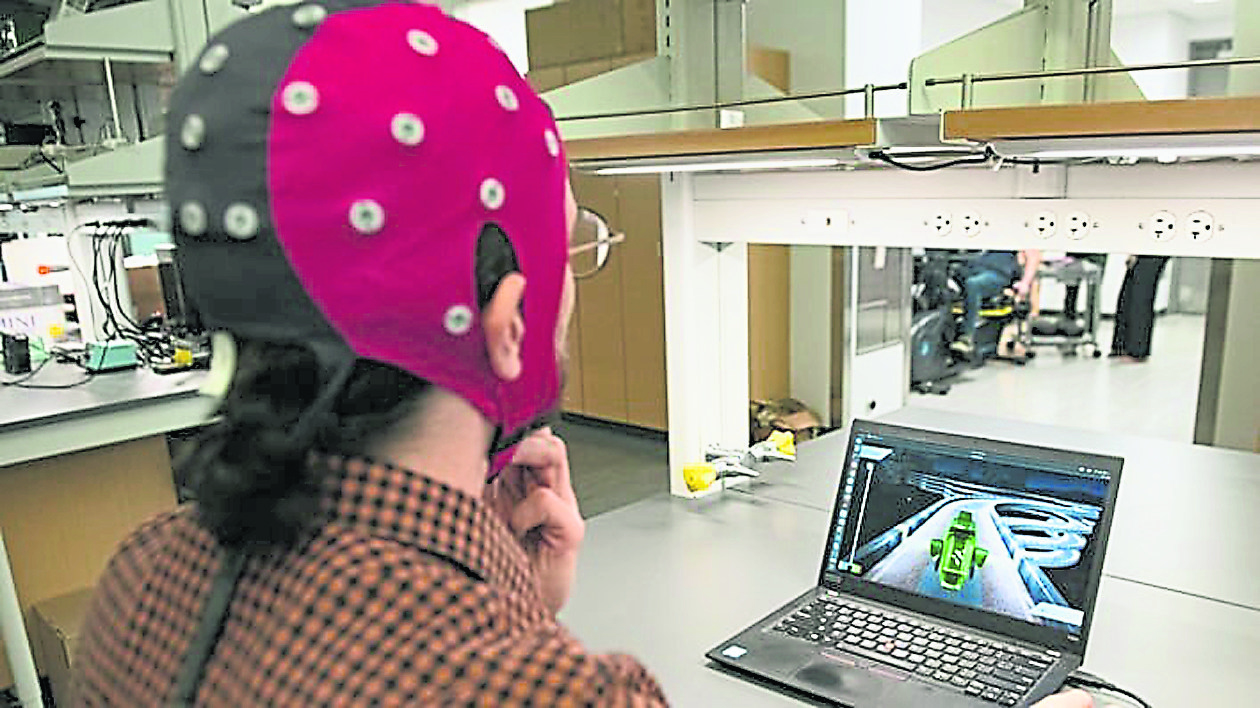

試想像一下,人類未來只需戴上一頂酷炫的黑紅色帽子,便無需如Neuralink般先接受侵入性手術,就能如科幻片中的絕地武士使用原力般憑意念操控機器人。

曾經,我們以為用意念控制一切是科幻小說中的情節,但在Neuralink推出後,如今,意念控制已切切實實的出現在我們所生活的世界裡。然而,大部份民眾多認為,安裝侵入式腦機介面以擷取腦波的方式需要承擔極高的風險,且外界也批評不斷。

不過,我們如今或許有了替代方案!根據美國德克薩斯大學奧斯汀分校的研究團隊所說,他們創造出一種可穿戴式腦機介面(BCI, brain-computer interface),並允許用戶僅通過意念就能玩電動遊戲。

“現在,我們完全不需要動刀動針就可以實現這個夢想。”

研究員在《PNAS Nexus》期刊上發表的一項新研究中提到,這項裝置的外型是一頂黑紅相間、內襯含腦波偵測電極的帽子,其存在的目的是要讓任何人都可以使用,而無需像其他穿戴式腦機介面般需要進行大量校準或侵入性手術。

過後,研究員利用機器學習一種叫做“解碼器”的黑科技,並讓這頂神奇帽子能快速適應每個人的獨特腦波。

即使你從未接觸過這類科技,它也能在短時間內跟你建立心電感應。在一次實驗當中,18名沒有任何相關使用經驗的測試者戴上了這頂腦波帽,僅經過5次的腦力訓練,他們就成功地掌控了一些介面簡單的小遊戲,甚至還同時成功挑戰了賽車遊戲。

須知,以往的腦機介面若要與用戶協作順暢,可是需要幾週甚至幾個月的磨合期。

甚至上個月於美國德克薩斯州奧斯汀開唱的SXSW(South by Southwest)音樂節上,研究員便在現場進行測試,好讓幾名用戶能在幾分鐘內就學會了使用腦波帽控制2個機械手臂機器人。他們就像絕地武士一樣用原力控制機器,讓人不禁感嘆科幻片中的橋段已經可以在現實中上演。

不過,這項產品在大規模應用之前還需要更多的測試和修正,最重要的是,必須要讓身障人士真正受惠於此。

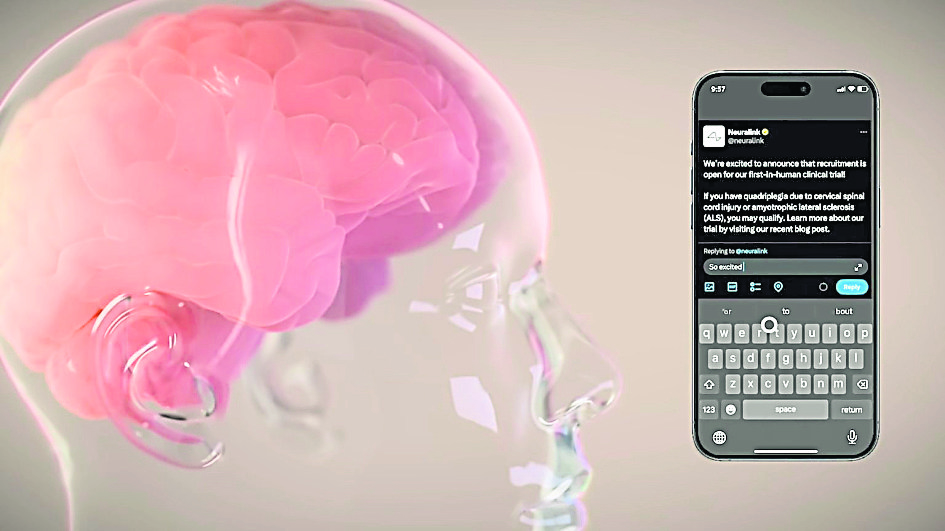

侵入性裝置傷大腦 受試者晶片曾失靈

馬斯克旗下的腦機介面公司Neuralink早期傳出有受試者在植入腦部晶片後部分晶片失靈的消息,隨後,Neuralink稱工程師已作出調整,並指系統已恢復正常。

對於腦機介面究竟是否安全的問題,各界一直爭論不休,而除了上述晶片失靈的案例,之前也有學者指開發團隊以針狀電極刺入人腦的做法將對大腦造成損傷。

Neuralink創始人之一的Benjamin Rapoport博士日前接受《華爾街日報》訪問時,言談間就曾暗指Neuralink在安全性上有着相當大的疑慮。

2016年,馬斯克和一群科學家共同創立了Neuralink,當時,Benjamin Rapoport博士也是其中一員。不久後,Benjamin Rapoport離開馬斯克團隊,創立了自己的公司Precision Neuroscience,選擇把“安全”放在公司技術發展的首位。

Benjamin Rapoport博士接受採訪時指出,他幾乎把職業生涯都奉獻給腦機介面,因他想要將它從科學研究層面帶入實際應用的醫學領域。但他認為,腦機介面進入醫學實用面的最大關鍵在於安全性,而這就是他創辦Precision Neuroscience且離開Neuralink的主要理由。

接着,Benjamin Rapoport說,對於醫療設備來說,安全通常意味着最小的人體侵入性,但在腦機介面發展的早期,為了從人腦中提取足夠豐富的訊息,開發團隊必須拿起微小的針狀電極刺入人腦,這對大腦來說會造成一定程度的損傷,因此,這並非醫學上的理想方案。

腦部晶片微電極絲脫落

或致腦膿腫及死亡

如何可在不損害大腦的情況下,從人腦中獲得足夠的資訊量?Benjamin Rapoport博士認為有辦法可以做到。他解釋說,目前,Neuralink實踐腦機介面的方法是基於穿透性微電極,但Precision Neuroscience則改用侵入性較小的表面微電極,即覆蓋大腦表面但不穿透腦部的微小電極,藉此讀取人腦資訊並作出互動。

Precision Neuroscience將“微創性”、“可延伸性”與“安全性”納入發展腦機介面的主要考量,他指出,這就是自家公司與Neuralink之間最顯著的不同。

腦機介面技術在過去10年間取得了巨大進步,讓民眾可以利用思想控制機械,且不只有馬斯克的Neuralink,包含 Synchron、Paradromics和Precision Neuroscience,各大團隊對於腦部設備的侵入性程度,都有着自己的解釋與理念。

Neuralink多年來受到外界大量批評,包括2020年遭《麻省理工學院科技評論》稱作“神經科學的秀場”,2022年更被指控進行不人道的動物科學實驗,導致15隻猴子因此死亡,以及稍早前首名在大腦植入Neuralink晶片的志願者在接受手術期間,頭骨內積聚空氣,引發俗稱“氣腦”的情況,手術數周後,一些連接晶片至腦部的微電極絲脫落,令晶片故障,若不及時治療可能會導致癲癇、腦部膿腫,甚至死亡。

過後,研究團隊通過一系列修復工作改善傳送訊號的技術及用戶介面後,已處理有關問題,並已就此事件通報美國食品及藥物管理局。