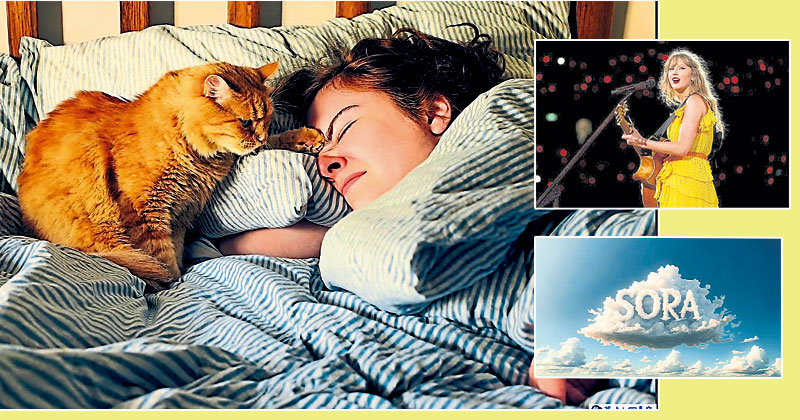

繼推出以文字生成內容和AI圖片的高端科技後,OpenAI再推出一項新科技“Sora”,讓用戶可用文字生成最長60秒的高品質且逼真的視頻,但目前只開放給少量學者、研究人員使用,估計這項AI模型或被人不當使用的風險極高,因此在覓得防範方法之前,可能將不會開放供民眾使用。

Advertisement

OpenAI稍早前公布已研發以文字生成視頻的AI模型Sora,它能一次生成包含多個角色、特定類型動作、主體與背景等細節精確的複雜場景。

立即注册 解锁全文

会员独享好文

繼推出以文字生成內容和AI圖片的高端科技後,OpenAI再推出一項新科技“Sora”,讓用戶可用文字生成最長60秒的高品質且逼真的視頻,但目前只開放給少量學者、研究人員使用,估計這項AI模型或被人不當使用的風險極高,因此在覓得防範方法之前,可能將不會開放供民眾使用。

OpenAI稍早前公布已研發以文字生成視頻的AI模型Sora,它能一次生成包含多個角色、特定類型動作、主體與背景等細節精確的複雜場景。