文 \ 蔡宗桓

一度爆紅的ChatGPT曾被譽為“無所不能”的機器人程式,但所謂“花無百日紅,‘機’無千日好”,在經過一段時日的人間操練後,它的缺點漸漸外露,而在各界爭相揭露其嚴重缺點後,更可說是“醜態百出”,就連歐洲一些國家如意大利和德國也因其安全漏洞而宣布禁用ChatGPT。

它除了答非所問引人詬病,更令人擔心的是,它所提供的一些錯誤資訊恐涉嫌誹謗他人,或可誤導他人,而澳洲赫本郡首長布萊恩胡德近日便因為ChatGPT誤將他列為一樁賄賂醜聞的犯案者之一而名譽受損,為此,他準備起訴推出ChatGPT的公司OpenAI,以正視聽。

所謂世上無完人,而由此事可見,世上也無“完機”。

自OpenAI於去年年杪公布人工智慧聊天機器人程式ChatGPT(Chat Generative Pre-trained Transformer)後,即迅速竄紅,成為科技界的新寵兒,也因此,坊間對它一直是“讚多於彈”,甚至一度把它神化成“無所不能”或“能力勝人”的機器人程式。

不過,在ChatGPT的缺點逐漸顯露後,預料它將開始漸漸退熱,而它目前最引人“矚目”及詬病的缺點莫過於答案“有欠精準”,不僅如此,它所提供的一些資料或答案甚至涉嫌誹謗他人名譽,或是足以誤人子弟。

雖然ChatGPT的用途廣泛,且可被用以編寫文章、回答問題等等,但因其資料多源自網絡資料庫,所以難免有誤。

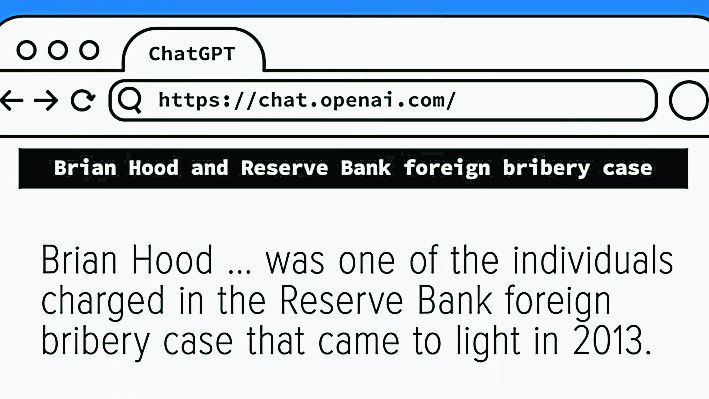

根據《路透社》的報導,澳洲赫本郡(Hepburn Shire)首長布萊恩胡德被民眾發現ChatGPT誤將他列為2000年代初期澳洲儲備銀行(Reserve Bank of Australia)子公司一樁外國賄賂醜聞的犯案者之一,他因擔心名聲受損,便委託律師協助處理此事。

布萊恩胡德也說,若OpenAI不更正ChatGPT目前所提供有關他因行賄入獄的不實指控,他將會起訴OpenAI,而這也可能成為全球首宗針對人工智慧進行訴訟的案件。

胡德的律師說,胡德確實曾在澳洲儲備銀行的這家子公司澳洲印鈔公司(Note PrintingAustralia)工作,但他其實並非犯案者,而是舉報公司賄賂官員的“吹哨者”,即是他向當局舉報公司為贏得印鈔合約而向國外官員行賄一事,同時,他也從未因被指控犯罪而入獄。

胡德的律師已於3月21日向OpenAI公司寄出一封信,希望OpenAI在28天內修正錯誤資訊,否則將會面臨誹謗訴訟。

其律師也說,OpenAI還沒回覆胡德發出的信函,且未對路透社的詢問信作出回應。如果胡德提起訴訟,相信那將會是史上第一件對人工智慧ChatGPT提出訴訟的案件。

胡德委託的高登事務所(Gordon Legal)的合伙人諾頓(James Naughton)告訴路透社:“這次對人工智慧及IT領域的產物提出誹謗訴訟,將是新世代的里程碑。”

“胡德是人民選出的官員,假如他管轄的區域有人因為這些資訊而對他產生錯誤的看法,那就會影響很大。對於所有人來說,你沒辦法知道有關資訊到底是怎樣來的,因所有資訊都沒有標註來源,所以只能將責任歸屬到OpenAI身上。”

ChatGPT引用不存在報導 誤指法學教授性騷擾學生

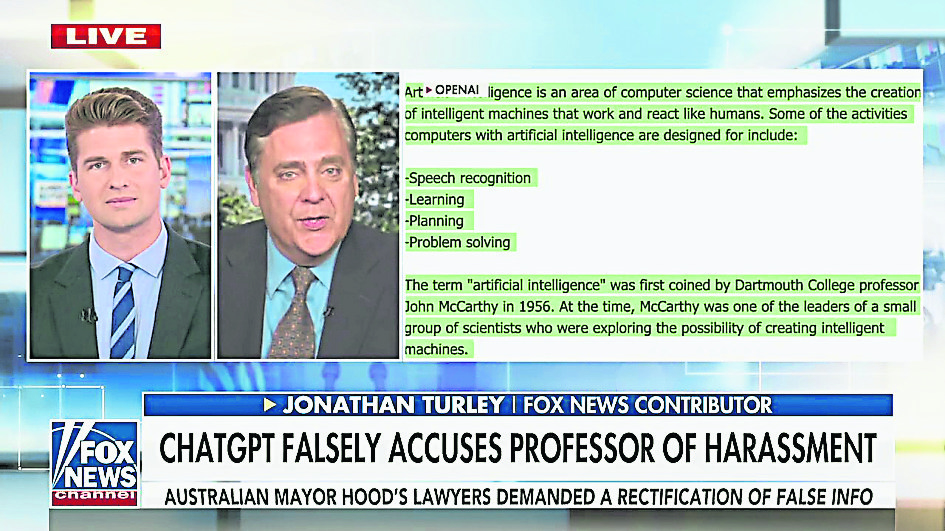

在GPT-3.5及GPT-4等多模態模型(large multimodal model)竄紅後不久,美國喬治華盛頓大學(GWU)法律系教授圖里(Jonathan Turley)日前便接獲一封電子郵件,指他的名字竟出現在聊天機器人ChatGPT的結果頁面上,讓他感到不可思議。

根據《華盛頓郵報》(The Washington Post)的報導,ChatGPT生成的回答中出現了一個以《華盛頓郵報》2018年報導作為參考來源的內容,而它更直指圖里曾作出性暗示,且曾在當時帶學生至加拿大出遊時,刻意想吃學生的豆腐。

其實,該篇被指為《華盛頓郵報》的報導根本不存在,而圖里也根本不曾帶學生去加拿大。

據悉,加州一名律師是在進行研究時,指示ChatGPT列出幾名曾性騷擾他人的相關法律學者,結果赫然發現圖里的名字被列其中。

雖然圖里本身是替新聞評論版撰文的常客,且偶爾會向媒體反應部分內容須修改,但他這次遭聊天機器人“誣指”性騷擾他人後,卻求助無門。

其實,繼ChatGPT後,其他的生成式AI聊天機器人也如雨後春筍般冒出,並加上與微軟Bing及Google等搜尋引擎無縫接軌合成Bing Chat及Bard後,AI的走向也越來越偏,乃至於常提供錯誤及不實的資訊。

這種情況除了引起專家及一般民眾對於AI發展的擔憂,同時也衍生出類似虛構的錯誤資訊該如何控管,以及該由誰出面負責等疑問。

任職於南加大(University of Southern California)的人工智慧專家克勞福德(Kate Crawford)則強調:“由於這些系統回覆得很肯定,易讓人錯誤假設這些系統真的知道很多事,而這就會造成判斷何謂事實,以及何謂錯誤的資訊的難度。」

此外,圖里後來接受《華盛頓郵報》採訪時則說,他已在自己的Twitter上發文表明,現在的他似乎已被AI組成的陪審團以莫須有的罪名定罪了。

“這真的是滿駭人的,而且這樣的指控也會嚴重影響到個人名譽。”